不被屏蔽的网页爬虫抓取(2026解决方案)

2026.02.26 09:37

2026.02.26 09:37在2026年,从第三方网站获取数据的需求持续增长,无论是用于电子商务价格监控、新闻聚合,还是SEO分析。然而,现代网站对自动化访问的防御也变得越来越严密。很多网站部署了如Cloudflare、PerimeterX或DataDome等高级反机器人系统,传统的简单HTTP请求往往在第一步就会被直接拦截。本文将为你梳理2026年最新、最有效的网页抓取策略,帮助你绕过复杂的防御机制,稳定获取所需数据。

一、突破反爬虫拦截的核心技术策略

要让爬虫不被屏蔽,核心原则只有一个:让你的自动化程序在行为和特征上,看起来与真实人类用户的浏览器无异。

1.代理IP的合理部署与轮换

如果所有请求都来自同一个数据中心IP,目标服务器会迅速将你封锁。

· 使用住宅代理:数据中心代理容易被识别。住宅代理使用的是由互联网服务提供商分配给真实家庭用户的IP地址,隐蔽性极强。

· 配置IP轮换池:每次发出请求或建立新会话时更换IP地址。如果目标网站主要服务于特定地区(例如美国本地的电商平台),请确保你的代理IP地理位置与目标用户群一致,避免因地理位置异常触发警报。

2.深度定制与管理浏览器指纹

现代反机器人系统不再仅仅检查IP和User-Agent,它们会通过JavaScript检测浏览器的TLS握手特征、Canvas绘图、WebGL渲染差异以及音频指纹。

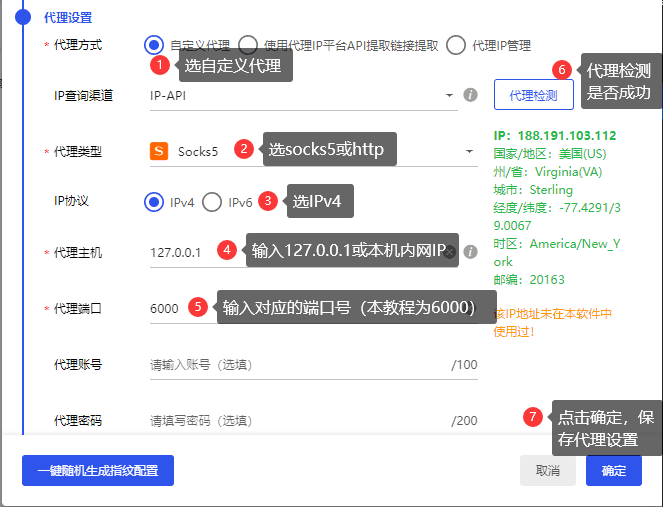

为了应对这种深度的指纹检测,除了使用隐身插件(如Puppeteer Stealth)外,许多专业的数据采集团队会引入比特浏览器来作为底层的环境支撑。比特浏览器是一款专业的防关联指纹浏览器,能够为每个抓取会话提供完全隔离的运行环境。

在实际的抓取流程中,你可以利用比特浏览器的本地自动化API接口(支持与Playwright或Selenium无缝对接),批量生成具备独立且真实硬件指纹(如特定的操作系统、屏幕分辨率、字体库和显卡渲染特征)的浏览器窗口。通过为比特浏览器中的每个指纹环境绑定不同的代理IP,你的爬虫集群在目标网站看来,就是来自世界各地、使用不同真实设备的普通人类用户。这种基于真实硬件指纹修改的功能,从根本上解决了因设备特征单一而被批量封禁的问题。

3.模拟真实用户行为

机器人的行为通常是线性且有规律的,而人类的行为则充满随机性。

· 随机化请求频率:不要以固定的秒数间隔发送请求。引入随机延迟(例如在2到7秒之间随机等待)。

· 模拟鼠标与页面交互:在需要执行JavaScript或加载动态内容的页面上,使用自动化工具模拟随机的鼠标滑动、悬停以及非恒定速度的页面滚动。

· 避开蜜罐陷阱:网站开发者经常会在页面中隐藏一些普通用户看不见(如使用CSS `display: none`),但爬虫很容易解析并点击的链接。在抓取时,务必过滤掉这些不可见的元素。

4.优化请求头与TLS特征

· 保持请求头更新:确保你的User-Agent与当前主流浏览器版本一致,并正确配置`Referer`和`Accept-Language`,让流量来源显得自然。

· 处理TLS指纹:不同编程语言的默认HTTP客户端(如Python的requests或NodeJS的普通http模块)具有容易被识别的TLS握手特征。考虑使用特定的反检测库修改TLS指纹,或者直接依赖基于真实浏览器内核的工具来处理请求。

二、2026年主流网页抓取工具选择方案

现代网页抓取已经细分为不同的流水线阶段:获取页面(绕过防御)、解析数据、以及任务调度。混合使用正确的工具可以事半功倍。

1.获取网页与解除屏蔽

这是目前最困难的一步。

· 全托管API服务(如ScrapingBee或Scrapfly):这类API直接为你处理了代理轮换、指纹伪装、JavaScript渲染以及验证码破解。你只需要发送目标URL,就能直接返回干净的HTML代码。这极大节省了维护基础设施的时间。

· 本地自动化控制(Playwright / Puppeteer):如果你需要处理极其复杂的登录流程(如双重认证),或者希望结合比特浏览器实现更底层的环境控制,Playwright是一个优秀的选择。它提供了强大的现代浏览器控制能力和自动等待机制。

2.HTML数据解析

拿到网页源代码后,你需要快速提取所需字段。

· BeautifulSoup (Python):对结构不规范的HTML有极好的包容性,API设计非常符合Python习惯,适合快速开发。

· Cheerio (Node.js):如果你在JavaScript生态中,Cheerio提供了类似jQuery的语法,它纯粹在DOM层面解析,不涉及浏览器渲染,因此速度极快且内存占用低。

3.大规模爬行调度

· Scrapy (Python):当你的抓取目标达到数千甚至上百万个URL时,Scrapy是不可或缺的框架。它内置了高效的异步调度、并发控制、重试机制以及数据导出管道。通常的做法是用Scrapy处理调度,将高难度的请求派发给Scrapfly等API或本地的Playwright节点。

三、逆向工程+API抓取

许多动态网站的数据并不是直接写在HTML中的,而是通过前端代码向后端的非公开API请求获取的。

与其费力去渲染复杂的网页DOM结构,不如打开浏览器的开发者工具(Network面板),观察页面加载数据时发出的XHR或Fetch请求。

1. 找到返回JSON数据的核心接口。

2. 分析该请求需要的请求头(Headers)和参数(Payload)。

3. 在你的代码中直接模拟这个API请求。

这种方法不仅抓取速度极快,而且返回的数据通常是高度结构化的JSON格式,完全省去了HTML解析的麻烦。唯一的难点在于,部分网站的API请求会附带动态加密的签名参数,这就需要你具备一定的JavaScript逆向分析能力,找出加密逻辑并用代码复现。

总结:

应对反爬虫机制是一场持续的攻防战。通过合理分配代理、精细化管理浏览器环境、并辅以正确的工具链,你可以构建出稳定且高效的数据采集系统。同时,在进行数据抓取时,也应注意控制访问速率,遵守目标网站的规范,避免对服务器造成恶意破坏。

BitBrowser

BitBrowser

双端协同,多开账号

双端协同,多开账号 丰富的指纹配置,有效防关联

丰富的指纹配置,有效防关联 多员工协同管理,高效运营

多员工协同管理,高效运营